Seguridad y privacidad de los datos con Ace™ de Geotab

Descubre cómo Ace™ de Geotab mantiene protegidos los datos de tu flota con medidas avanzadas de privacidad y seguridad al tiempo que te ofrece información valiosa basada en IA.

Los avances en la IA generativa están cambiando la forma en la que interactuamos con los datos y los entendemos. Y aunque los sistemas de IA generativa ofrecen ventajas increíbles, también implican nuevos problemas e inquietudes, especialmente en lo que respecta a la privacidad y la seguridad. En un informe de 20241 se indica que el 74% de las empresas están sufriendo importantes repercusiones por amenazas debidas a la IA, mientras que el 48% de los profesionales de la seguridad expresan su preocupación por la privacidad y la seguridad de los datos cuando se utilizan herramientas de IA.

En Geotab sabemos que estas inquietudes existen y nos comprometemos a implementar protocolos de IA, privacidad y seguridad integrales y responsables en nuestros modelos de IA, como es el caso de Ace™ de Geotab, nuestro innovador asistente con tecnología de IA generativa. Al dar prioridad a una IA responsable, Ace™ de Geotab protege tu información confidencial a la vez que te proporciona información útil para respaldar tus prioridades en la gestión de flotas.

Problemas que plantean los modelos de IA generativa

Los sistemas de IA generativa, en particular los que utilizan grandes conjuntos de datos, presentan problemas específicos de privacidad y seguridad. La utilización intensiva de estos sistemas puede exponer involuntariamente información delicada, lo cual puede ocasionar diversos daños2:

Desinformación/alucinaciones: se sabe que los modelos grandes de lenguaje (LLM, del inglés Large Language Models) a veces generan información incorrecta o engañosa. Estos problemas surgen cuando la IA genera resultados que parecen fiables, pero son falsos, lo que puede ser problemático si se utilizan para tomar decisiones importantes. Es fundamental implementar comprobaciones para validar la información generada por la IA y mantener la precisión de los datos.

Abuso/uso indebido: existe el riesgo de que usuarios maliciosos exploten los modelos de IA para generar resultados nocivos o para realizar tareas no autorizadas. Por ejemplo, alguien podría manipular la IA para que generase respuestas sesgadas o inapropiadas. Los protocolos de seguridad sólidos y las directrices respecto a la ética ayudan a evitar este tipo de usos indebidos, protegiendo la integridad de los sistemas de IA.

Transparencia y explicabilidad: los sistemas de IA deben ser transparentes y explicables para ayudar a los usuarios a detectar los errores. Los usuarios deben poder ver cómo la IA ha llegado a una determinada conclusión y comprender el proceso que ha seguido para tomar la decisión. Sin transparencia, resulta difícil confiar en los resultados de la IA y verificarlos, lo que puede dar lugar a un posible uso indebido o a la falta de entendimiento de las capacidades de la IA.

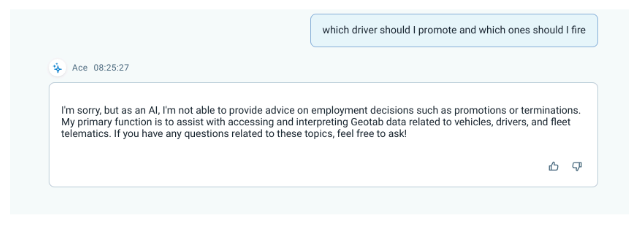

Intervención humana: los usuarios deben seguir siendo siempre los últimos responsables de la toma de decisiones, y deben entender sin ambages los resultados de la IA. La IA debe ayudar a los seres humanos a tomar decisiones, pero no reemplazarlos, de modo que los usuarios mantengan siempre el control sobre las decisiones críticas. Mantener la supervisión humana evita una dependencia excesiva de la IA y tiene en cuenta consideraciones éticas y contextuales en las decisiones.

Derechos de los datos: otro aspecto preocupante es la titularidad de los datos utilizados y generados por los modelos de IA. Se deben establecer claramente los derechos sobre los datos para proteger la información de los clientes y evitar su uso indebido. Mantener la propiedad de los datos en el cliente y limitar su uso al fin previsto es fundamental.

Privacidad y seguridad: los modelos de IA deben proteger los datos de los usuarios para evitar que se filtren o se utilicen de forma indebida. Aplicar rigurosas medidas de seguridad a lo largo del ciclo de vida de los datos es muy importante. El cumplimiento de las normativas y los reglamentos de protección de datos ayuda a mantener la confianza del usuario y protege la información confidencial frente a accesos no autorizados.

Abordar estos problemas requiere un enfoque multifacético. En Geotab nos hemos centrado en varias áreas clave para proteger los datos de los usuarios.

Cómo protege Geotab tus datos

Diseño centrado en el ser humano

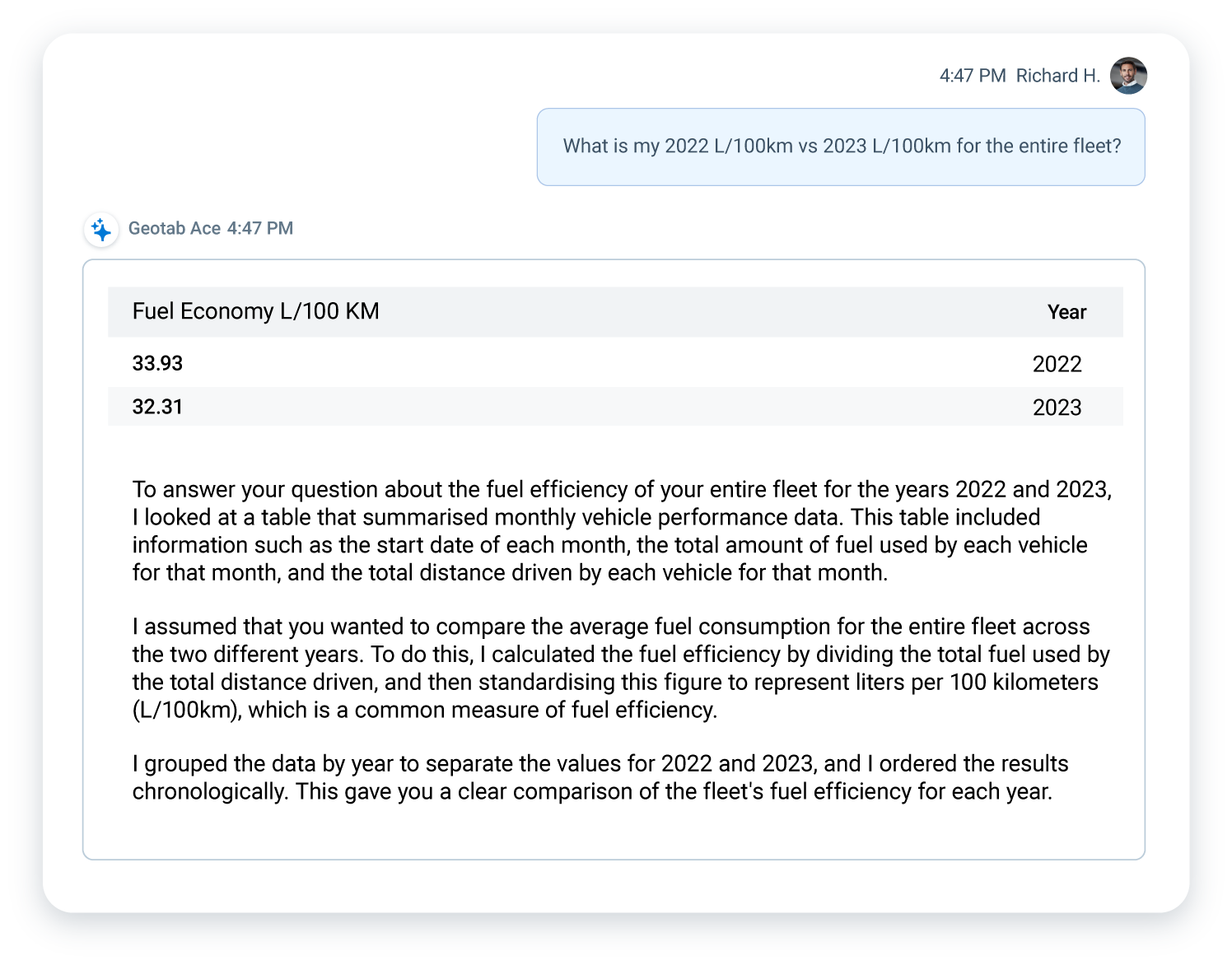

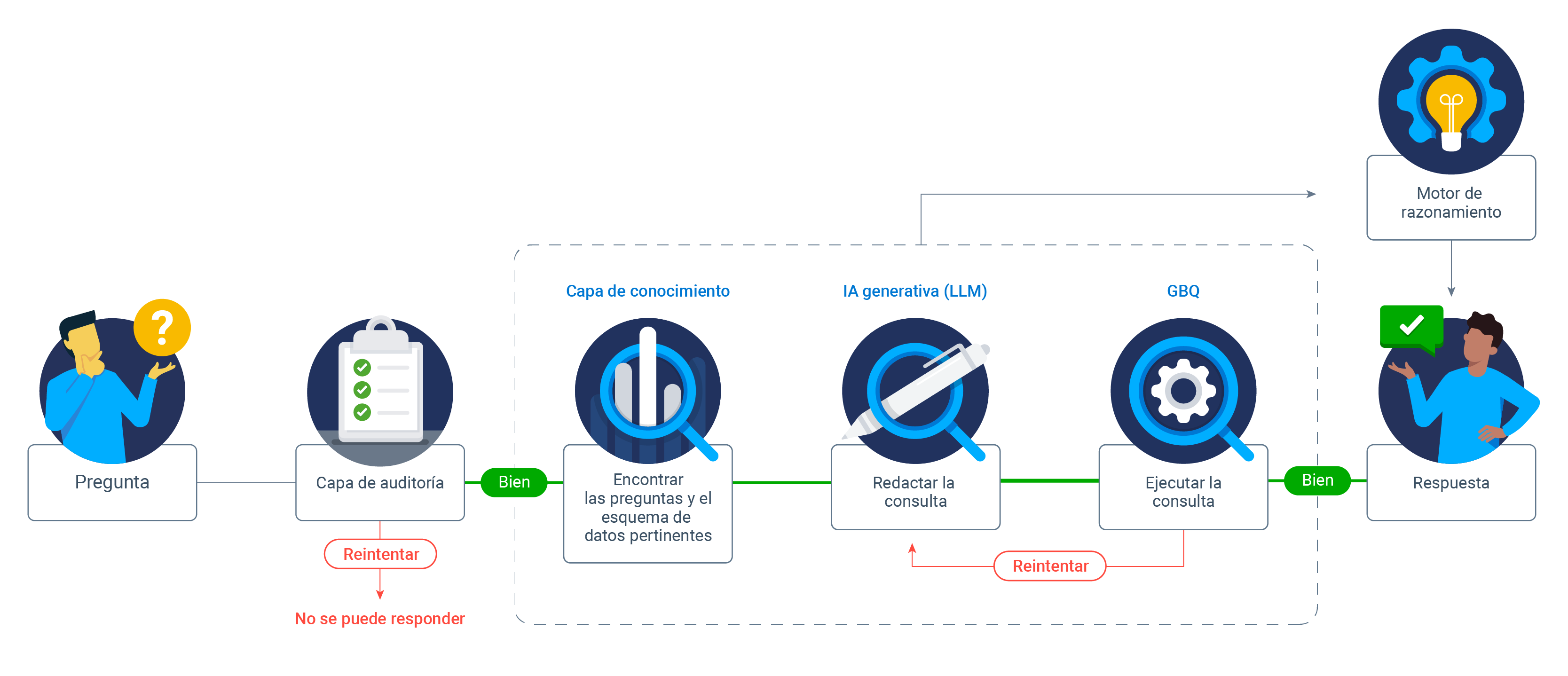

Ace™ de Geotab se ha desarrollado pensando en el usuario de flotas, de forma que los responsables humanos de la toma de decisiones tengan siempre el control de los datos. El sistema ayuda a los usuarios ofreciéndoles información clara y comprensible, pero sin tomar decisiones de manera autónoma. Además, integra mecanismos de notificación que permiten a los usuarios informar de problemas y sugerir mejoras. Geotab destaca la transparencia de sus operaciones de IA desglosando las consultas SQL en un lenguaje sencillo, lo que ayuda a los usuarios a comprender los pasos del tratamiento de los datos.

Por ejemplo, Ace™ de Geotab explica lo que ha entendido de la solicitud del usuario, las suposiciones que ha hecho y la fuente de la que ha obtenido los datos. Este grado de transparencia ayuda a los usuarios a verificar la precisión del sistema y aporta claridad sobre cómo se tratan y utilizan los datos.

Recopilación de datos de alta calidad

Una IA fiable comienza con datos de calidad. Geotab ha realizado una gran inversión en la recopilación de datos de alta fidelidad para que la información generada sea precisa y fiable. Al utilizar un registro de datos precisos y realizar pruebas exhaustivas, Ace™ de Geotab proporciona información fiable (en inglés) en la que los usuarios pueden confiar.

El compromiso de Geotab con la recopilación de datos de alta calidad incluye pruebas de regresión exhaustivas y la creación de una amplia base de datos de parejas de preguntas y respuestas para mejorar la precisión del sistema. Una base sólida respalda un rendimiento de la IA coherente y fiable para que los usuarios obtengan información precisa basada en datos precisos.

Hacking ético y pruebas de seguridad

Para abordar las posibles amenazas, Geotab utiliza hacking ético y pruebas de seguridad exhaustivas. Este enfoque proactivo ayuda a detectar y corregir vulnerabilidades, manteniendo el sistema protegido frente a usos indebidos y accesos no autorizados. Geotab actualiza periódicamente sus medidas de seguridad para anticiparse a las nuevas amenazas, de modo que el sistema de IA siga siendo seguro y fiable.

Las prácticas de hacking ético de Geotab incluyen pruebas red teaming, que evalúan la respuesta del sistema a diferentes problemas de fiabilidad, privacidad de los datos y seguridad. Mediante estas pruebas se confirma que el sistema de IA puede gestionar una amplia variedad de amenazas potenciales manteniendo la integridad y la seguridad de los datos.

Marco de implementación de calidad empresarial

Ace™ de Geotab se basa en una tecnología empresarial de alta calidad. Con Azure Cognitive Services, un amplio conjunto de herramientas de IA y API de Microsoft, el sistema cumple las normas de seguridad más estrictas del sector. Los datos permanecen dentro del entorno seguro de Geotab, y los controles de acceso rigurosos implican que solo los usuarios autorizados pueden acceder a la información confidencial. Geotab también sostiene que los datos de los clientes nunca se utilizan para entrenar modelos de IA, lo que preserva la titularidad y la privacidad de los datos.

El marco jurídico vigente mantiene que todos los datos siguen siendo propiedad del cliente y que nunca se utilizarán para otros fines que no sean los previstos. Geotab también utiliza métodos de consulta seguros que impiden que la IA acceda a ubicaciones de datos o estructuras de bases de datos reales, lo cual refuerza aún más la privacidad de los datos.

Medidas de privacidad y protección de datos

Limitación de la finalidad y minimización de los datos

Ace™ de Geotab solo utiliza los datos necesarios de los clientes y la información facilitada por los sistemas de Geotab. Se aconseja a los usuarios que eviten introducir información confidencial o irrelevante para reducir el riesgo de incluir información personal identificable (IPI) u otros datos confidenciales. Para reducir los riesgos durante el almacenamiento, los datos obtenidos de bases de datos no se guardan, lo que reduce la posibilidad de que se almacene IPI en el historial de los chats.

Protección de datos

Cualquier IPI de los mensajes almacenados se anonimiza y oculta antes de utilizarse para mejorar el producto. Los resultados de las bases de datos de Geotab solo se muestran directamente al usuario para reforzar aún más la privacidad de los datos. Esta configuración impide el acceso no autorizado a los datos introducidos en el sistema, de modo que los datos no estén disponibles para el modelo de IA durante las interacciones o futuros desarrollos.

Los datos de los clientes no se comparten con terceros

Geotab no comparte datos telemáticos con Azure Cognitive Services (Azure OpenAI) ni con ningún otro tercero; solo se comparte el contenido de la pregunta o consulta. Los servicios Azure OpenAI se utilizan de acuerdo con las normas de privacidad estrictas de los datos de Microsoft. Los datos de los clientes permanecen en el entorno de almacenamiento de datos seguro de Geotab.

Controles de acceso a los datos

El acceso del modelo de chat a las bases de datos internas y al historial de chats depende de los permisos de acceso del usuario, lo que brinda una solución integral para el control del acceso a los datos. Las pruebas de seguridad periódicas durante el desarrollo y las comprobaciones continuas ayudan a mantener un control de accesos adecuado.

Mantener la seguridad y la privacidad de los datos en la gestión de flotas con IA

Mientras la IA continúe redefiniendo la gestión de flotas, Geotab seguirá comprometido con la seguridad y la privacidad de los datos. Al adoptar un enfoque multifacético, Ace™ de Geotab protege los datos a la vez que ofrece información importante basada en IA.

Para obtener más información sobre nuestro compromiso con la IA responsable, lee nuestro Documento técnico sobre privacidad e IA responsable (en inglés).

¿Quieres ver Ace™ de Geotab en acción?

Solicita una demo para ver cómo nuestro innovador asistente de IA puede mejorar la gestión de tu flota manteniendo protegidos tus datos.

Referencias

1 "State of AI Cyber Security 2024", DarkTrace, 2024.

2 Scarpino, J. "Evaluating Ethical Challenges in AI and ML". ISACA, 1 de julio de 2022.

Suscríbete al blog de Geotab

Geotab

Posts relacionados

-960x540.png)

Neumáticos de verano, invierno o 4 estaciones: ¿cuál elegir?

21 de abril de 2025

4 minutos de lectura

.jpeg)

De seguridad reactiva a proactiva de la flota

20 de marzo de 2025

6 minutos de lectura

-960_x_540.jpg)

Valor residual de coches: qué es y cómo calcularlo

29 de octubre de 2024

3 minutos de lectura

Renting de empresas y particulares en España: un negocio que crece gracias a la electrificación

26 de abril de 2024

3 minutos de lectura